在 2026 年,衡量一个 AI 后端工程师(Gopher)水平的标准,除了看他能写出多复杂的 Agent 逻辑,更要看他能否在保障性能的同时,把 Token 成本降到极致。

随着 RAG 和长上下文应用的普及,Prompt Caching(提示词缓存) 已成为后端架构中的“省钱神技”。今天我们就来聊聊,作为 Go 开发者,在实战中应如何最大程度地利用厂商的缓存机制。

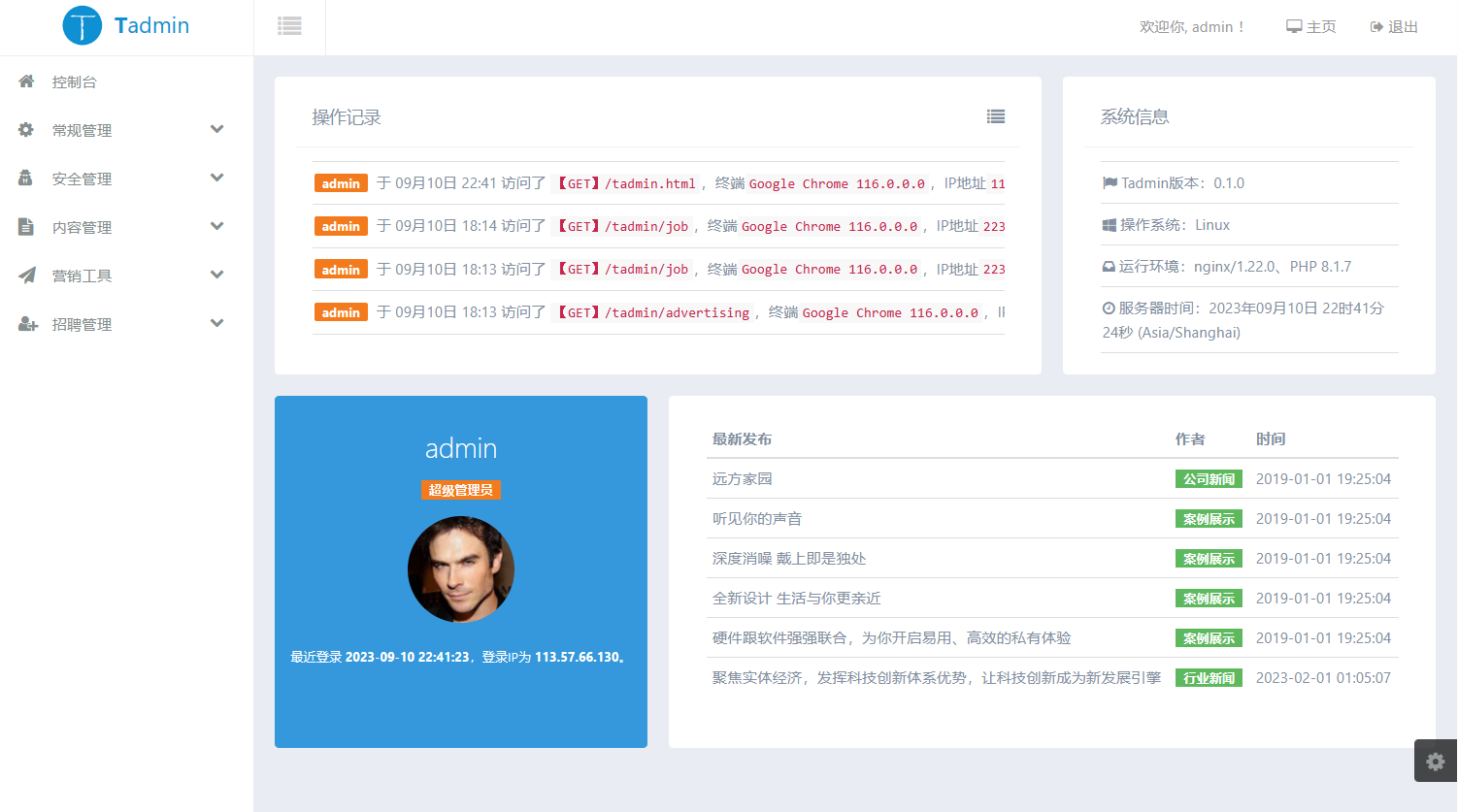

主流厂商的缓存原理图谱

要利用缓存,首先要明白它的“脾气”。目前的缓存机制主要分为两类:

1. 隐式哈希匹配(如 OpenAI、DeepSeek) 这类厂商非常“聪明”。他们会对你发送的 Prompt 从第一个字符开始计算哈希值(Hash)。只要文本前缀与之前处理过的内容完全一致,后端推理集群就会自动复用内存中的计算状态。

- 注意:通常有 1024 Tokens 的起步门槛,短文本不会触发。

2. 显式标记触发(如 Anthropic、Gemini)

这类厂商需要你“明确告知”。例如 Anthropic 需要打上 cache_control 标签。

- 计费陷阱:Anthropic 的缓存“写入”比普通输入略贵,但“读取”极便宜。因此,只有预期会被复用 2 次以上的内容才建议手动缓存。

- Gemini 特色:支持通过 API 创建持久化的 Context Cache 并返回一个

cache_id,适合超大型(如 100k+)的固定知识库。

实战:最大化利用缓存的三大策略

作为 Gopher,我们在构建 AI 应用时应如何落地这些机制?建议遵循以下“三部曲”:

一、 静态前缀法则:重构你的 Prompt 结构

缓存是按“前缀”匹配的,这意味着顺序决定了一切。在构造请求时,务必将最不经常变动的内容放在最前面。

错误的顺序:

[用户问题] + [系统提示词] + [参考文档](用户问题每轮都变,导致后面所有内容都无法缓存)

正确的顺序:

[系统提示词] + [参考文档] + [用户问题](前两部分可以长期稳定在缓存中)

在 Go 中,建议将 Prompt 模块化,确保拼接顺序的绝对统一。

二、 动态变量后置:避开缓存失效的“暗礁”

很多 Gopher 习惯在系统 Prompt 中加入动态变量,这在缓存环境下是“自杀行为”。

避坑指南:

- 时间戳:不要在开头写

Current Time: 14:05:23,这会让缓存每秒失效一次。 - 用户信息:不要在开头写

User ID: 12345。 - 随机数:所有随机种子必须放在 Prompt 的最末尾。

最佳实践:如果必须使用这些信息,请将其作为独立的消息段,放在静态文档之后发送。

三、 工程化封装:实现缓存感知的 Go 结构体

在 Go 后端,我们需要对请求对象进行更高层次的封装,使其能够自动处理缓存逻辑。

// 逻辑:如果是 Anthropic,在 KnowledgeBase 后注入 "cache_control": {"type": "ephemeral"}

// 利用 Go 的强类型特性,确保拼接顺序的绝对统一

func (r *AIChatRequest) BuildPrompt() string {

return r.SystemPrompt + r.KnowledgeBase + r.Query

}四、 稳定排序法则:解决 RAG 检索的不确定性

这是很多 RAG 系统缓存命中率低的主因。在检索 Top-K 文档时,由于向量评分的微小差异,文档顺序可能在两轮请求间发生跳变(如 A-B 变成 B-A)。

策略:在拼接 Prompt 前,务必对检索到的文档块按 ID 或文件名进行二次排序。只要内容没变,生成的字符串顺序就必须完全一致,从而强制模型命中缓存。

五、 上下文压缩与“摘要缓存”

对于极长对话,即使有缓存,成本也会随轮数增长。

策略:当对话达到阈值(如 20 轮),在 Go 后端异步启动一个“总结任务”,将旧对话压缩为一段摘要。接下来的请求将以 [系统提示词] + [摘要缓存] 作为新前缀。这样既保留了记忆,又大幅降低了每一轮的基础 Token 消耗。

写在最后

在 AI 浪潮的下半场,能够写出漂亮的 Prompt 只是基本功。如何在大规模生产环境中,通过精细的工程手段实现成本与性能的最优解,才是区分“调包侠”与“AI 架构师”的分水岭。

作为 Gopher,我们追求极致的效率。在构建 AI 应用时,多花一点心思在缓存策略上,不仅能为公司省下巨额开销,更能显著提升用户的交互体验。

记住:模型是概率的,但工程架构必须是精密的。